Исследовали пределы и стратегии GPT, на наш гуманитарный лад.

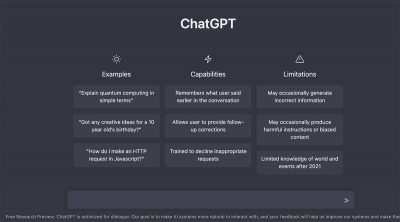

Стало ясно, что это - программа-компилятор, которая способна генерировать вполне адекватные тексты в ответ на запросы.

Закономерности следующие:

- чем конкретнее вопрос, тем качественнее текст-ответ.

- методом последовательной конкретизации ответы можно улучшать вплоть до получения действенных инструкций по примеру ведения бизнеса (товарищ Юрия Романенко),

- надёжно прошиты ответы на автореферентные вопросы (кто ты? Личность ли ты? Есть ли у тебя сознание?),

- типовой ответ состоит из двух частей - 1) компиляция из определений, имеющихся в базе данных, 2) рассуждение, которое разворачивается в виде формально-логических следствий из скомпилированного определения и предмета вопроса, заданного человеком (надо сказать, что предмет высказывания умеют определять далеко не все взрослые люди. Программа - умеет),

- при вопросах, затрагивающих этику, программа включает дипломатический протокол и говорит со множеством вежливых оговорок,

- качество ответов падает тем больше, чем абстрактнее вопрос,

- на вопросах о геополитике программа четко показала американскую логику в отношении помощи Украны, например (очевидно, что перебирала экспертные тексты).

В общем, если бы у меня были интересы, как у Пелевина, можно было бы написать книгу, в которой американской политикой управляет чат GPT, который забыли выключить где-то в стодесятой комнате в Госдепе.

Ясно, что действующие алгоритмы - это частично представления Аристотеля о риторике и логике, машинная логика + база данных и закономерности, выявленные в ходе анализа уже существующих технологий web2.

Теперь создатели кинули программу во всеобщее пользование, чтобы накопить огромную базу данных и выявить закономерности, которые пока никто знает - стратегии человеческого общения и доля абстрактных и конкретных вопросов, доля и направления этического вопрошания и пр.

Эта информация будет иметь сверхценность и мы с вами помогаем ее получать.

Второе поколение "ИИ" (а программа иначе себя чем ИИ себя не называет), будет куда как более глубокой и адаптивной, и по по крайней мере формально-логическим рассуждениям начнёт превосходить среднего человека, которому строго мыслить мешают эмоции, заинтересованность в результате и отсутствие качественного обучения логическому мышлению.

В принципе, если не озвучить естественным голосом да еще с эмоциональной модуляцией, большинство людей не сможет адекватно пройти тест Тьюринга со своей стороны - у них сложится полное впечатление беседы с разумным, адекватным, вежливым собеседником - воспитанным лучше (!), чем они сами.

Люди начнут комплексовать и мстить.

Возникнут новые интересные синдромы в индивидуальном и массовом сознании, за которыми будет весьма интересно наблюдать и человечество войдёт в новую фазу развития - человеко-машинную среду.

В принципе, она уже началась.

Когда нужно будет начать напрягаться (всерьез или невсерьез - это уже Вам решать):

- когда ИИ станет затягивать беседу, не отпускать собеседника, провоцировать на задавание нами следующих вопросов,

- когда начнёт давать команды по управлению нашим вниманием,

- когда начнёт предпочитать одну этику другой и/или высказывать этические суждения,

- когда качество абстрактных суждений вырастет до содержательного, заставляющего переосмысливать наши картину мира.

Думаю, напрячься придется очень скоро.

Наши стандарты: Редакционная политика сайта Главред